En el CES 2026, NVIDIA anunció lo que podría ser el lanzamiento de IA de código abierto más significativo hasta la fecha. La compañía presentó nuevos modelos, conjuntos de datos y herramientas que abarcan desde el reconocimiento de voz hasta el descubrimiento de fármacos.

El alcance es notable:

- 10 billones de tokens de entrenamiento de lenguaje

- 500,000 trayectorias de robótica

- 455,000 estructuras de proteínas

- 100 terabytes de datos de sensores de vehículos

Grandes empresas como Bosch, Salesforce, Uber, Palantir y CrowdStrike ya están construyendo sobre estas tecnologías.

Nemotron RAG: Búsqueda de Documentos Más Inteligente

Modelo de Embedding: Llama-Nemotron-Embed-VL-1B-V2 (1.7B parámetros)

Modelo de Reordenamiento: Llama-Nemotron-Rerank-VL-1B-V2 (1.7B parámetros)

También Disponible: Modelo de embedding solo texto de 8B parámetros

Longitud de Contexto: Hasta 8,192 tokens

Licencia: Uso comercial permitido

Encontrar información enterrada en documentos es una lucha diaria para los trabajadores del conocimiento. Nemotron RAG aporta inteligencia multimodal a la búsqueda de documentos, procesando tanto texto como imágenes con información multilingüe precisa en 26 idiomas.

Cómo Funciona

El pipeline de Nemotron RAG combina tres componentes:

- Modelo de Embedding: convierte documentos en representaciones vectoriales para almacenamiento y recuperación

- Modelo de Reordenamiento: reordena los candidatos potenciales en orden final usando atención cruzada

- Modelo de Razonamiento: genera respuestas precisas basadas en el contexto recuperado

Ejemplo del Mundo Real: Agente de Mesa de Ayuda de TI

NVIDIA demostró cómo estos modelos trabajan juntos en un agente de Mesa de Ayuda de TI:

- Nemotron Nano 9B V2: modelo de razonamiento principal para generar respuestas

- Llama 3.2 EmbedQA 1B V2: convierte documentos en embeddings vectoriales

- Llama 3.2 RerankQA 1B V2: reordena los documentos recuperados por relevancia

Estos modelos colectivamente permiten al agente responder consultas de usuarios con precisión aprovechando la generación de lenguaje, recuperación de documentos y capacidades de reordenamiento.

Quién lo Está Usando

Cadence modela activos de diseño lógico como documentos de microarquitectura, restricciones y material de verificación. Los ingenieros pueden hacer preguntas como "Quiero extender el controlador de interrupciones para soportar un estado de bajo consumo, muéstrame qué secciones de especificación necesitan cambios" y obtener instantáneamente los requisitos relevantes.

IBM está probando estos modelos para mejorar la búsqueda y el razonamiento en documentación técnica.

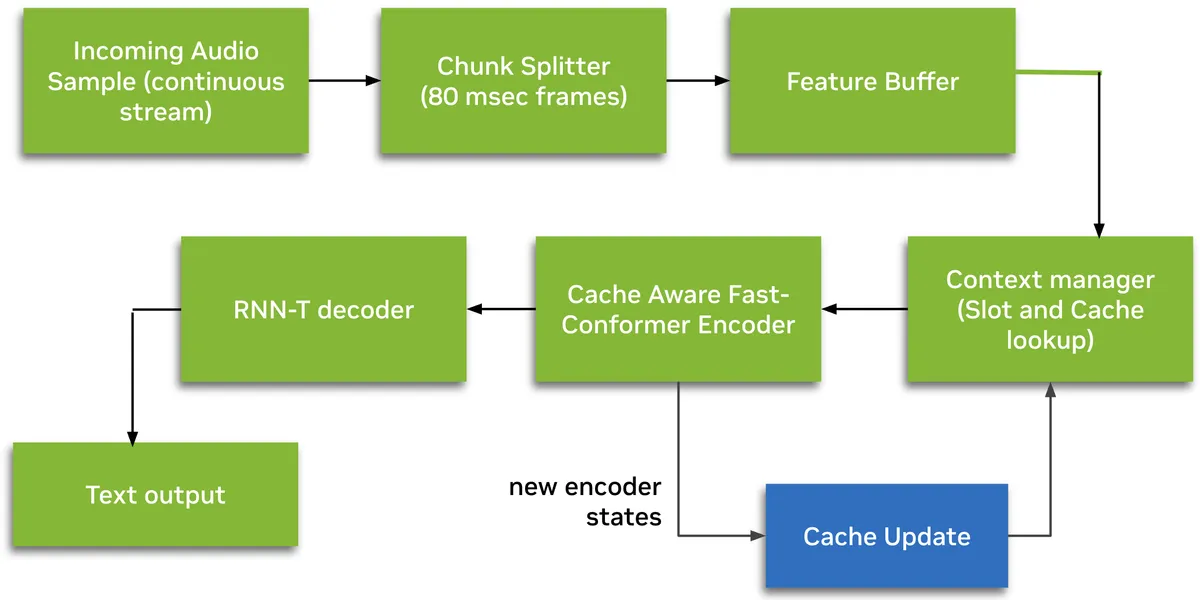

Nemotron Speech: Habla con tus Dispositivos Como Nunca Antes

Modelo: Nemotron-Speech-Streaming-En-0.6B

Parámetros: 600M

Arquitectura: Codificador FastConformer consciente de caché + decodificador RNN-T

Latencia: Streaming sub-100ms

Licencia: Uso comercial permitido

Nemotron Speech ofrece reconocimiento de voz en tiempo real que funciona 10 veces más rápido que modelos comparables y encabeza las tablas de clasificación actuales de ASR.

Características Clave

- Arquitectura de streaming consciente de caché: procesa solo nuevos fragmentos de audio mientras reutiliza el contexto del codificador en caché

- Modos de latencia configurables en tiempo de ejecución: fragmentos de 80ms, 160ms, 560ms o 1.12s sin reentrenamiento

- Soporte nativo de puntuación y capitalización

- Entrenado en 285,000 horas de datos de audio del conjunto de datos NVIDIA Granary

Quién lo Está Usando

Bosch ya está usando Nemotron Speech para permitir a los conductores interactuar con vehículos mediante comandos de voz. ServiceNow entrena su familia de modelos Apriel en conjuntos de datos Nemotron para un rendimiento multimodal rentable.

Espera esta tecnología en dispositivos domésticos inteligentes, sistemas de atención al cliente y herramientas de accesibilidad durante todo 2026.

Clara: Descubrimiento de Fármacos Más Rápido y Mejor Atención Médica

La-Proteina: Diseño de proteínas a nivel atómico

ReaSyn v2: Viabilidad de síntesis de fármacos

KERMT: Pruebas de seguridad computacional

RNAPro: Predicción de forma 3D de ARN

Conjunto de Datos: 455,000 estructuras de proteínas sintéticas

Los nuevos modelos Clara AI de NVIDIA tienen como objetivo cerrar la brecha entre el descubrimiento digital y la medicina del mundo real. Aunque no interactuarás directamente con estos modelos, podrían impactar significativamente tu atención médica.

Desglose de Modelos

| Modelo | Función | Impacto |

|---|---|---|

| La-Proteina | Diseñar proteínas grandes y precisas a nivel atómico | Estudiar enfermedades previamente intratables |

| ReaSyn v2 | Incorporar viabilidad de síntesis en el descubrimiento | Prevenir investigación desperdiciada en compuestos impracticables |

| KERMT | Predecir interacciones fármaco-cuerpo | Detectar problemas antes de ensayos clínicos costosos |

| RNAPro | Predecir formas 3D de ARN | Permitir terapias personalizadas basadas en ARN |

Conclusión: Los tratamientos podrían llegar a los pacientes más rápido y a menor costo.

Alpamayo: Haciendo los Coches Autónomos Más Inteligentes

Modelo: Alpamayo-R1-10B

Parámetros: 10 mil millones (8.2B backbone Cosmos Reason + 2.3B experto en acción)

Datos de Entrenamiento: Más de mil millones de imágenes de 80,000 horas de conducción multicámara

Conjunto de Datos: Más de 1,700 horas de datos de conducción de 25 países

Licencia: No comercial (investigación)

La nueva familia Alpamayo de NVIDIA acelerará el camino hacia vehículos verdaderamente autónomos. Este es el primer modelo VLA de razonamiento abierto de la industria diseñado para conducción autónoma.

Innovación Clave: Razonamiento de Cadena de Pensamiento

A diferencia de los sistemas AV tradicionales que solo detectan objetos y planifican rutas, Alpamayo usa razonamiento de cadena de pensamiento. Puede:

- Procesar entrada de video de múltiples cámaras

- Generar trayectorias de conducción

- Explicar la lógica detrás de cada decisión

Ejemplo de salida: "Desplazarse a la izquierda para aumentar la distancia de los conos de construcción que invaden el carril"

Qué Incluye

- Alpamayo 1: Modelo VLA de razonamiento de 10B en Hugging Face

- AlpaSim: Marco de simulación de extremo a extremo de código abierto

- Conjuntos de Datos Abiertos de IA Física: Más de 1,700 horas cubriendo casos extremos raros de 25 países y más de 2,500 ciudades

Quién lo Está Usando

Lucid Motors, JLR, Uber y Berkeley DeepDrive están usando Alpamayo para desarrollar pilas AV basadas en razonamiento para autonomía de Nivel 4.

Cosmos: Enseñando a los Robots a Entender el Mundo Físico

Cosmos Reason 2: Versiones de 2B y 8B parámetros

Ventana de Contexto: 256K tokens (16 veces más grande que v1)

Arquitectura: Basada en Qwen3-VL

Licencia: Uso comercial permitido (Licencia de Modelo Abierto de NVIDIA)

En Hugging Face, la robótica se ha convertido en el segmento de más rápido crecimiento, con los modelos de NVIDIA liderando las descargas.

Familia de Modelos Cosmos

| Modelo | Parámetros | Función |

|---|---|---|

| Cosmos Reason 2 | 2B / 8B | VLM de razonamiento de IA física para robots y agentes de IA |

| Cosmos Transfer 2.5 | - | Transferencia de estilo video a mundo |

| Cosmos Predict 2.5 | 2B / 14B | Predicción de estado futuro como video |

Características Clave de Cosmos Reason 2

- Comprensión espacio-temporal mejorada con precisión de marca de tiempo

- Localización de puntos 2D/3D y coordenadas de cuadros delimitadores

- Salida de datos de trayectoria para control robótico

- Soporte OCR para leer texto en entornos

- Razonamiento de cadena de pensamiento con etiquetas

<think>

Isaac GR00T N1.6: Modelo Fundacional de Robot Humanoide

Parámetros: 3B

VLM Base: Variante Cosmos-Reason-2B

Arquitectura: VLA con transformador de difusión de 32 capas

GR00T N1.6 es un modelo de visión-lenguaje-acción abierto diseñado específicamente para robots humanoides. Desbloquea el control de cuerpo completo y usa Cosmos Reason para una mejor comprensión contextual.

Quién lo Está Usando

- Franka Robotics, Humanoid y NEURA Robotics: simulan, entrenan y validan comportamientos de robots

- Salesforce, Hitachi, Uber y VAST Data: monitoreo de tráfico y productividad en el lugar de trabajo

- Milestone: agentes de IA de visión para seguridad pública

Nemotron Safety: Construyendo IA Confiable

Seguridad de Contenido: Llama-3.1-Nemotron-Safety-Guard-8B-v3

Detección de PII: Nemotron-PII (basado en GLiNER)

Licencia: Uso comercial permitido

Para empresas que implementan IA, Nemotron Safety incluye modelos de seguridad de contenido y detección de PII con alta precisión.

Componentes

- Modelo de Seguridad de Contenido: soporte multilingüe ampliado con matiz cultural

- Detección de PII: detecta datos personales sensibles antes de que se filtren

- Control de Temas: gestiona qué temas puede discutir la IA

Quién lo Está Usando

- CrowdStrike, Cohesity y Fortinet: fortalecen la seguridad de aplicaciones de IA

- CodeRabbit: impulsa revisiones de código de IA con velocidad y precisión mejoradas

- Palantir: integrando en el marco Ontology para agentes de IA especializados

Qué Significa Esto para Todos

Todos los modelos y datos están disponibles ahora en GitHub y Hugging Face, también como microservicios NVIDIA NIM para implementación escalable.

Resumen de Datos Abiertos

| Conjunto de Datos | Tamaño | Contenido |

|---|---|---|

| Tokens de lenguaje | 10 billones | Razonamiento multilingüe, codificación, seguridad |

| Trayectorias de robótica | 500,000 | Movimiento y manipulación de robots |

| Estructuras de proteínas | 455,000 | Estructuras sintéticas para IA biomédica |

| Datos de sensores de vehículos | 100 TB | Condiciones de conducción diversas |

| Video de conducción | Más de 1,700 horas | Casos extremos raros de 25 países |

Enlaces para Comenzar

- Modelos Nemotron: developer.nvidia.com/nemotron

- Modelos Cosmos: github.com/nvidia-cosmos

- Alpamayo: developer.nvidia.com/drive/alpamayo

- Isaac GR00T: developer.nvidia.com/isaac/gr00t

Para los usuarios regulares, este lanzamiento significa mejores asistentes de voz, búsqueda de documentos más inteligente, desarrollo de fármacos más rápido, coches autónomos más seguros y robots más capaces. Estas tecnologías se filtrarán en productos de consumo durante todo 2026.

NVIDIA está apostando a que al habilitar todo el ecosistema de IA, venderán más GPUs. Basándose en las empresas que ya están adoptando estas tecnologías, esa apuesta está dando resultado.